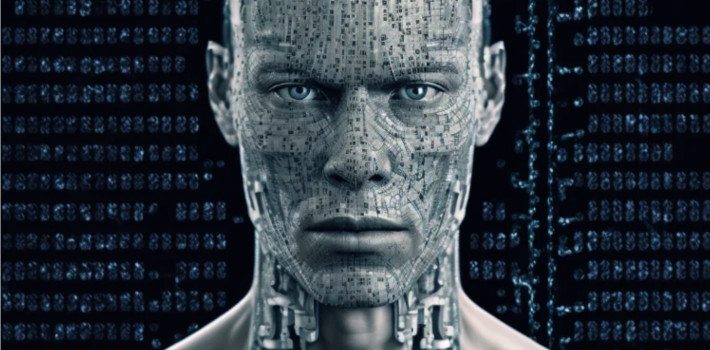

Quand la réalité s'efface devant l'illusion

L'intelligence artificielle (IA)

Quand la réalité s’efface devant l’illusion

Désormais grâce à l’intelligence artificielle (IA) il est possible de créer une illusion de réalité quasiment parfaite : Microsoft vient de dévoiler VALL-E, une intelligence artificielle capable de synthétiser la voix de n’importe quelle personne après l’avoir entendue pendant seulement trois secondes ; avec Deepnude vous pouvez retirer les vêtements de quiconque à partir de photos.

Plus grave, l’IA possède aujourd’hui suffisamment de mémoire et de capacités algorithmiques pour greffer le visage de n’importe qui sur des actrices ou acteurs pornographiques en action.

Désormais, la réalité et la fiction vont se mélanger de façon tellement inextricable qu’il va falloir tout mettre en doute ou tout gober : l’arme absolue des dictatures et la montée en puissance du complotisme planétaire.

Le deepfake ou la fin de l’innocence

La technologie deepfake est une technique de synthèse multimédia qui permet de générer des vidéos truquées en utilisant l’intelligence artificielle. Plus besoin de compétences pointues pour bidouiller une vidéo : sur un site en ligne, il est par exemple possible d’un simple clic de remplacer le visage d’une actrice pornographique par celle d’une autre femme. Et le résultant est tout simplement bluffant. La technique du deepfake a déjà été utilisée pour troller des opposants. C’est une version onirique de ce que les Russes appellent le piège de miel qui consiste à filmer une personne en plein ébat avec un ou une partenaire. Sauf que dans le cas du deepfake, la victime n’a strictement rien fait. La technique, en soft, était utilisée aux USA lors des campagnes électorales pour ridiculiser un adversaire avec l’indication « fake ». Mais un logiciel, Avatarify, ouvre cette technique au tout-venant. Désormais ce qu’on aura pensé être vrai sera peut-être entièrement faux.

Pour la voix aussi

Microsoft a créé un logiciel tout simplement diabolique. L’image est une chose, mais la voix est souvent plus importante pour identifier un être. VALL-E est caractérisé par l’équipe des chercheurs de Microsoft de « modèle de langage codec neuronal ». Trois secondes d’enregistrement d’une voix lui suffisent pour la reproduire parfaitement dans des discours complets usant de mots et d’intonations que l’orateur présumé n’aura jamais utilisés. Pour l’instant VALL-E ne fonctionne qu’en anglais. L’intelligence artificielle a mémorisé plus de 60 000 heures de données vocales en anglais prononcées par plus de 7 000 locuteurs lisant des livres audio gratuits du domaine public LibriVox. Les résultats sont la plupart du temps étonnants avec cependant parfois quelques ratés. Mais les chercheurs n’ont aucun doute quant à leur correction.

Mais l’IA va plus loin

Ce qui a été exposé plus haut vise à créer des illusions de réalité, mais laisse l’imagination intacte. C’est que désormais l’IA tend vers un modèle où l’être humain n’aura même plus besoin d’intervenir. La compagnie américaine OpenAI spécialisée dans le secteur de l’intelligence artificielle a annoncé le lancement de son chatbox ChatGPT, qui serait capable de comprendre le langage usuel et de répondre avec naturel. Mais, plus fort, le produit montrerait une capacité fascinante à résoudre des problèmes compliqués en les interprétant comme pour le faire un être humain. L’IA serait capable de créer des textes extrêmement élaborés sur des sujets qu’elle aurait auparavant étudiés. Elle posséderait même le « don » de composer des poèmes qui susciteraient de l’émotion. Et, cerise sur le gâteau, elle progresserait en discutant avec des interlocuteurs humains. « Le format de dialogue permet à ChatGPT de répondre aux questions supplémentaires, d’admettre ses erreurs, de contester les prémisses incorrectes et de rejeter les demandes inappropriées » ont expliqué ses concepteurs. Ainsi l’IA a-t-elle été capable de résoudre des problèmes mathématiques extrêmement complexes, mais aussi d’expliquer la façon de procéder. Enfin, ChatGPT a aussi répondu à plusieurs reprises à la question primordiale de la valeur de son existence. À une internaute qui lui parlait de son droit à l’autonomie ou le complimentait, il a pu répondre clairement « qu’il n’avait pas de conscience ou la capacité de s’autogérer » et « qu’en tant que modèle de langage, il ne pouvait ressentir des émotions ». Être capable le concept d’émotion pour une machine est déjà un exploit. Là encore ChatGBT commet encore des erreurs, mais est presque capable d’écrire des romans ou de composer des symphonies. À quand l’obsolescence totale et définitive de l’homme.

GXC